'신뢰할 수 있는 인공지능 실현전략' 발표…2025년까지 추진

(출처: 과학기술정보통신부) *재판매 및 DB 금지

[서울=뉴시스] 이진영 기자 = 인공지능이 빠르게 확산되는 만큼 그에 따른 우려도 커짐에 따라 정부가 누구나 신뢰할 수 있는 인공지능이 만들어질 수 있도록 2025년까지 실천과제 10가지를 제시했다. 특히 인공지능 신뢰 구현을 위한 법제도·윤리·기술적 요구사항을 종합한 인공지능 개발 가이드북을 제작·보급한다는 계획이다.

과학기술정보통신부는 13일 대통령 직속 4차산업혁명위원회 제22차 전체회의에서 사람이 중심이 되는 인공지능(AI)을 위한 '신뢰할 수 있는 인공지능 실현전략'을 이같이 발표했다.

4차 산업혁명을 견인하는 범용 기술인 인공지능이 전 산업·사회에 빠르게 도입·확산되며 혁신을 창출하고 있으나, 인공지능 챗봇 ‘이루다’(2021년 1월), 오바마전대통령 딥페이크(2018년 7월), MIT 개발 사이코패스 인공지능(2018년 6월) 등 예상하지 못한 사회적 이슈와 우려도 함께 대두되고 있다.

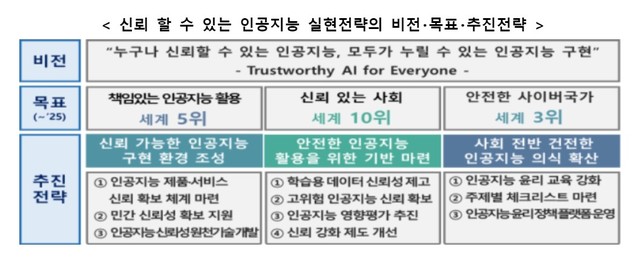

과기부는 인공지능 실현전의 비전을 '누구나 신뢰할 수 있는 인공지능, 모두가 누릴 수 있는 인공지능 구현'을 정하고 기술·제도·윤리 측면의 3대 전략과 10대 실행과제를 통해 오는 2025년까지 단계적으로 추진하기로 했다.

중점 방향은 민간의 인공지능 서비스 구현을 체계적으로 지원하고, 이용자가 믿고 안전하게 사용할 수 있도록 제도를 보완하며, 사회 전반에 건전한 인공지능 윤리를 확산하는 것이다.

이번 실천전략에 따라 과기부는 인공지능 제품·서비스 구현단계별 신뢰 확보 체계를 마련하기로 했다.

개발 단계에서는 국내외 신뢰성 관련 법·제도·윤리·기술적 요구사항을 한 번에 확인할 수 있는 '개발 가이드북'을 제작·보급하기로 했다.

검증 단계에서는 개발 가이드북을 준수한 신뢰성 확보 여부와 그 수준을 확인하고 평가할 수 있는 검증절차·항목·방법 등의 '검증체계'를 마련하고 제시한다.

인증 단계에서는 기술·윤리적 요구사항을 충족해 검증체계를 통과한 제품·서비스에 대해 민간 자율 인증과 공시를 추진한다.

기술·재정적 상황이 열악한 스타트업 등도 체계적으로 신뢰성을 확보해 나갈 수 있도록 인공지능 구현을 위한 '데이터 확보→ 알고리즘 학습→ 검증'을 통합 지원하는 플랫폼을 운영할 계획이다.

민관이 인공지능 학습용 데이터 제작공정에서 공통으로 준수해야 할 신뢰 확보 검증 지표 등의 표준 기준을 민간과 함께 마련해 통일성 있게 구축될 수 있도록 확산시키기로 했다.

국민의 안전이나 기본권에 잠재적 위험을 미칠 수 있는 고위험 인공지능의 범주를 설정하고, 서비스 제공 전에 해당 인공지능의 활용 여부를 이용자에게 고지하게끔 할 계획이다.

인공지능 윤리기준에 대한 구체적인 행위 지침으로, 연구・개발자, 이용자 등이 업무, 일상생활 등 속에서 윤리 준수 여부를 자율점검할 수 있는 체크리스트도 개발 보급하기로 했다.

이 밖에 학계·기업·시민단체·공공 등 다양한 사회 구성원이 참여하여 인공지능 윤리에 대해 깊이 있게 토의하고 의견 수렴 및 발전방향을 논의하는 공론의 장을 마련·운영한다는 방침이다.

최기영 과기장관은 "최근 발생했던 이루다 챗봇 사건은 우리 사회가 인공지능의 신뢰성에 대해 어떻게 대처해야 하는지 많은 숙제를 안기는 계기가 됐다"며 "기업·연구자 등이 인공지능 제품·서비스 개발 과정에서 혼란을 겪거나 이로 인해 국민이 피해 보지 않도록 인공지능 신뢰 확보 기준을 명확화하는 등 사람이 중심이 되는 인공지능 강국 실현을 위해 동 전략을 차질 없이 추진해나갈 계획"이라고 말했다.

◎공감언론 뉴시스 [email protected]

과학기술정보통신부는 13일 대통령 직속 4차산업혁명위원회 제22차 전체회의에서 사람이 중심이 되는 인공지능(AI)을 위한 '신뢰할 수 있는 인공지능 실현전략'을 이같이 발표했다.

4차 산업혁명을 견인하는 범용 기술인 인공지능이 전 산업·사회에 빠르게 도입·확산되며 혁신을 창출하고 있으나, 인공지능 챗봇 ‘이루다’(2021년 1월), 오바마전대통령 딥페이크(2018년 7월), MIT 개발 사이코패스 인공지능(2018년 6월) 등 예상하지 못한 사회적 이슈와 우려도 함께 대두되고 있다.

과기부는 인공지능 실현전의 비전을 '누구나 신뢰할 수 있는 인공지능, 모두가 누릴 수 있는 인공지능 구현'을 정하고 기술·제도·윤리 측면의 3대 전략과 10대 실행과제를 통해 오는 2025년까지 단계적으로 추진하기로 했다.

중점 방향은 민간의 인공지능 서비스 구현을 체계적으로 지원하고, 이용자가 믿고 안전하게 사용할 수 있도록 제도를 보완하며, 사회 전반에 건전한 인공지능 윤리를 확산하는 것이다.

이번 실천전략에 따라 과기부는 인공지능 제품·서비스 구현단계별 신뢰 확보 체계를 마련하기로 했다.

개발 단계에서는 국내외 신뢰성 관련 법·제도·윤리·기술적 요구사항을 한 번에 확인할 수 있는 '개발 가이드북'을 제작·보급하기로 했다.

검증 단계에서는 개발 가이드북을 준수한 신뢰성 확보 여부와 그 수준을 확인하고 평가할 수 있는 검증절차·항목·방법 등의 '검증체계'를 마련하고 제시한다.

인증 단계에서는 기술·윤리적 요구사항을 충족해 검증체계를 통과한 제품·서비스에 대해 민간 자율 인증과 공시를 추진한다.

기술·재정적 상황이 열악한 스타트업 등도 체계적으로 신뢰성을 확보해 나갈 수 있도록 인공지능 구현을 위한 '데이터 확보→ 알고리즘 학습→ 검증'을 통합 지원하는 플랫폼을 운영할 계획이다.

민관이 인공지능 학습용 데이터 제작공정에서 공통으로 준수해야 할 신뢰 확보 검증 지표 등의 표준 기준을 민간과 함께 마련해 통일성 있게 구축될 수 있도록 확산시키기로 했다.

국민의 안전이나 기본권에 잠재적 위험을 미칠 수 있는 고위험 인공지능의 범주를 설정하고, 서비스 제공 전에 해당 인공지능의 활용 여부를 이용자에게 고지하게끔 할 계획이다.

인공지능 윤리기준에 대한 구체적인 행위 지침으로, 연구・개발자, 이용자 등이 업무, 일상생활 등 속에서 윤리 준수 여부를 자율점검할 수 있는 체크리스트도 개발 보급하기로 했다.

이 밖에 학계·기업·시민단체·공공 등 다양한 사회 구성원이 참여하여 인공지능 윤리에 대해 깊이 있게 토의하고 의견 수렴 및 발전방향을 논의하는 공론의 장을 마련·운영한다는 방침이다.

최기영 과기장관은 "최근 발생했던 이루다 챗봇 사건은 우리 사회가 인공지능의 신뢰성에 대해 어떻게 대처해야 하는지 많은 숙제를 안기는 계기가 됐다"며 "기업·연구자 등이 인공지능 제품·서비스 개발 과정에서 혼란을 겪거나 이로 인해 국민이 피해 보지 않도록 인공지능 신뢰 확보 기준을 명확화하는 등 사람이 중심이 되는 인공지능 강국 실현을 위해 동 전략을 차질 없이 추진해나갈 계획"이라고 말했다.

◎공감언론 뉴시스 [email protected]